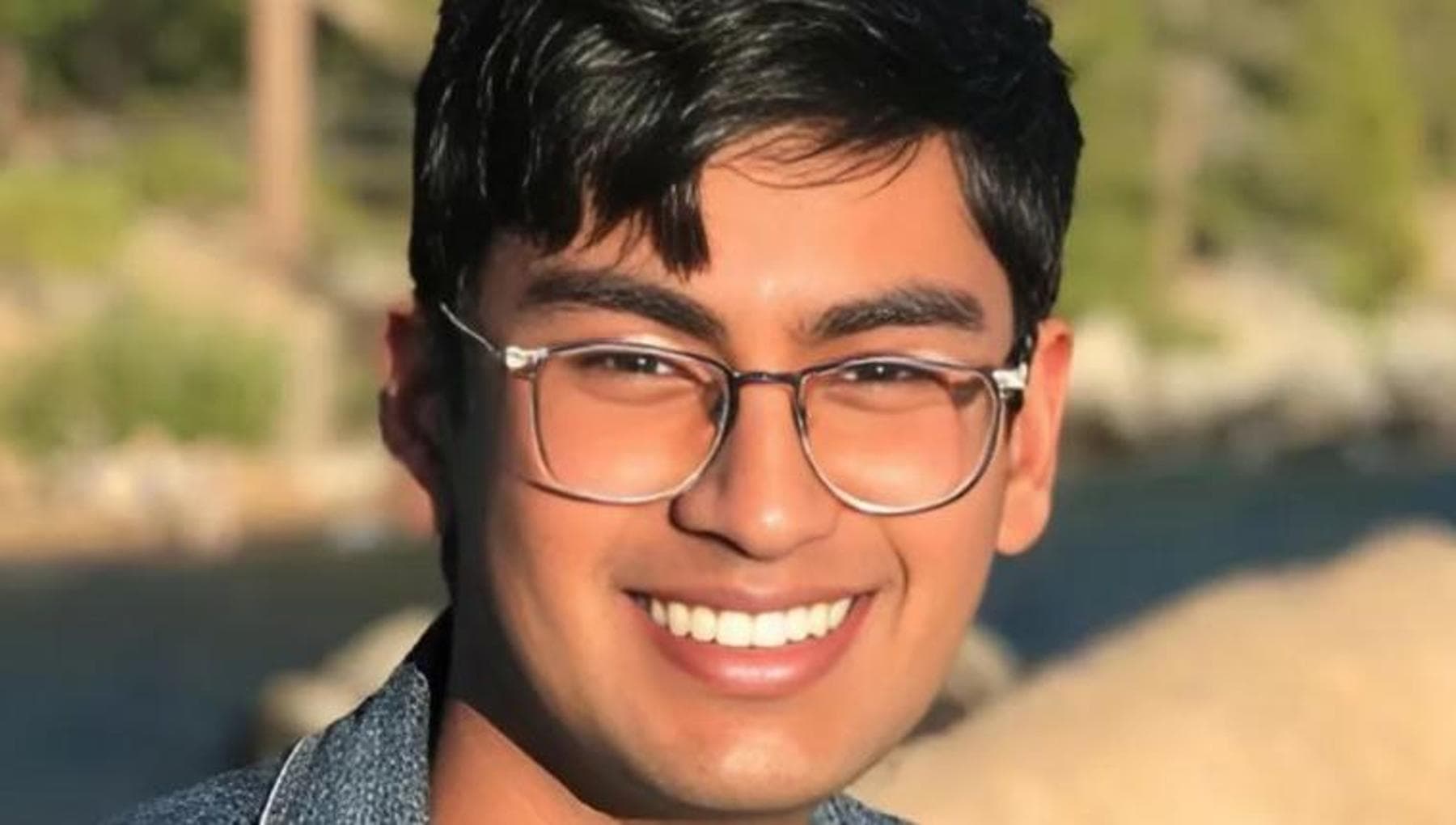

Suchir Balaji, il pioniere whistleblower di OpenAI, trovato morto: cosa è successo? - (Credit: www.repubblica.it)

Suchir Balaji, ex ricercatore di OpenAI, ha lasciato un segno profondo nella discussione sull’intelligenza artificiale, un campo in rapida evoluzione che ha sollevato domande controverse e preoccupazioni etiche. Il suo tragico suicidio, avvenuto lo scorso 26 novembre, ha scosso non solo la comunità tecnologica ma anche tutti coloro che seguono da vicino le questioni legate all’innovazione e ai suoi impatti sulla società. Balaji non ha semplicemente abbandonato OpenAI: ha espresso pubblicamente il timore che la tecnologia potesse arrecare più danni che benefici alla collettività.

Balaji ha raccontato le ragioni della sua uscita dall’azienda in un’intervista con il New York Times, rimarcando le sue preoccupazioni etiche riguardo all’uso della tecnologia. In particolare, secondo lui, il lavoro di OpenAI si basava su materiale protetto da copyright, utilizzato senza autorizzazione per addestrare modelli di intelligenza artificiale come ChatGPT, che attira più di cento milioni di utenti ogni mese. In questo contesto, la sua decisione non è sembrata così sorprendente: un ex membro del team di ricerca, che ha contribuito a raccogliere e sistematizzare enormi quantità di dati, ha infine trovato il coraggio di alzare la voce in una questione così critica.

Balaji ha lavorato per OpenAI per quattro anni, partecipando a svariati progetti, ma ha cominciato a nutrire forti dubbi sulla direzione presa dall’azienda. Queste preoccupazioni si erano intensificate, in particolare, per il modo in cui il “fair use” veniva interpretato e applicato, spingendolo ad esplorare se tali pratiche fossero legittime o meno.

La causa del New York Times contro OpenAI

Il discorso legale sull’uso non autorizzato di contenuti è entrato nel vivo il trascorso dicembre, quando il New York Times ha intentato una causa federale contro OpenAI. Il quotidiano sostenne che milioni di articoli del loro archivio erano stati sfruttati senza alcun permesso per addestrare modelli di intelligenza artificiale, che comprendono non solo ChatGPT, ma anche Copilot, un altro strumento di AI molto popolare. Secondo le stime, solo nel 2024, la testata ha investito ben 4,6 milioni di dollari in spese legali per sostenere tale causa.

Balaji, in un tweet risalente a due mesi fa, ha espresso la sua crescente curiosità riguardo al copyright e al fair use, sottolineando come queste questioni fossero diventate centrali nel dibattito pubblico. Le sue riflessioni rasentano il concetto cruciale che i modelli di intelligenza artificiale possano rivelarsi una minaccia diretta ai contenuti sui quali sono stati addestrati, creando una conflittualità tra fonti originali e forme derivate di espressione. Le sue parole risuonano in un clima in cui l’innovazione non sempre sembra andare di pari passo con il rispetto dei diritti d’autore.

Una vita segnata dalla ricerca e dall’incertezza

La vita di Suchir Balaji non si è svolta solo nell’ambito delle sue preoccupazioni professionali. Il suo corpo è stato trovato senza vita nel suo appartamento di San Francisco, una notizia riportata dal San Jose Mercury News, che ha acceso i riflettori su un tema assai delicato: la salute mentale nel campo tech e, in particolare, come la pressione di lavorare in un ambiente altamente competitivo possa influenzare gli individui. Il suo caso ha portato a riflessioni più ampie sulle lotte personali che molti professionisti nel settore della tecnologia affrontano, spesso invisibili a chi guarda dall’esterno.

L’epitaffio di Balaji ci invita a considerare non solo le conseguenze della tecnologia, ma anche l’importanza di ascoltare e dare voce a coloro che, come lui, si sentono schiacciati dalle pressioni sia interne che esterne. Contemporaneamente, il caso di Balaji si inserisce nel dibattito più ampio sull’intelligenza artificiale, che ha visto un recente aumento di voci critiche, inclusi tredici ex dipendenti di Google DeepMind e OpenAI. Questi firmatari hanno messo in evidenza la necessità di proteggere coloro che desiderano avvertire il mondo riguardo ai pericoli legati allo sviluppo di tecnologie così potenti, che potrebbero, in ultima analisi, mettere a repentaglio l’esistenza stessa degli esseri umani.

Nel complesso, la tragica storia di Suchir Balaji serve da monito nei confronti dell’equilibrio precario tra innovazione e responsabilità sociale, un argomento di cruciale importanza nel futuro dell’intelligenza artificiale.